NVIDIA Grace Hopper Superchip ve MLPerf

NVIDIA Grace Hopper Superchip, MLPerf Çıkarım Karşılaştırmalarına Hakim Oluyor

NVIDIA, en son tanıttığı NVIDIA GH200 Grace Hopper Superchip ile yapay zeka (AI) ve yüksek performanslı bilgi işlem dünyasında büyük bir sıçrama yaptı. Bu yeni teklif, MLPerf değerlendirmelerinde olağanüstü performans sergileyerek NVIDIA’nın bulut ve uç yapay zeka alanındaki becerisini ortaya koydu.

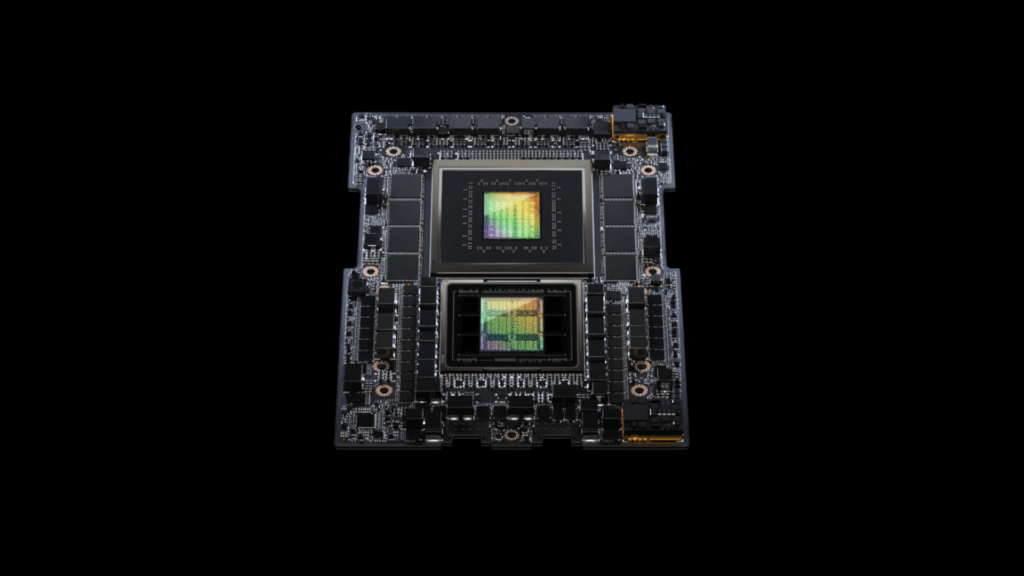

Çok Şey Konuşan Bir Süper Çip

GH200 Superchip sıradan bir çip değil. Hopper GPU’yu Grace CPU ile benzersiz bir şekilde birleştirerek daha yüksek bellek, bant genişliği ve en yüksek performans için CPU ile GPU arasındaki gücü otomatik olarak ayarlama yeteneği sağlar. Bu yenilikçi entegrasyon, çipin güç ve performans arasında hassas bir denge kurmasına olanak tanıyarak yapay zeka uygulamalarının ihtiyaç duydukları kaynakları ihtiyaç duydukları anda almalarını sağlar.

Olağanüstü MLPerf Sonuçları

MLPerf kıyaslamaları saygın bir endüstri standardıdır ve NVIDIA’nın GH200’ü hayal kırıklığına uğratmadı. Süper çip yalnızca tüm veri merkezi çıkarım testlerini yürütmekle kalmadı, aynı zamanda NVIDIA’nın yapay zeka platformunun çok yönlülüğünü de ortaya koyarak kapsamını bulut operasyonlarından ağın kenarlarına kadar genişletti.

Üstelik NVIDIA’nın H100 GPU’ları da geride kalmadı. Sekiz H100 GPU ile donatılmış HGX H100 sistemleri, tüm MLPerf Çıkarım testlerinde üstün verim sergiledi. Bu, H100 GPU’ların özellikle bilgisayar görüşü, konuşma tanıma, tıbbi görüntüleme, öneri sistemleri ve büyük dil modelleri (LLM’ler) gibi görevler için muazzam potansiyelini ve yeteneklerini vurgulamaktadır.

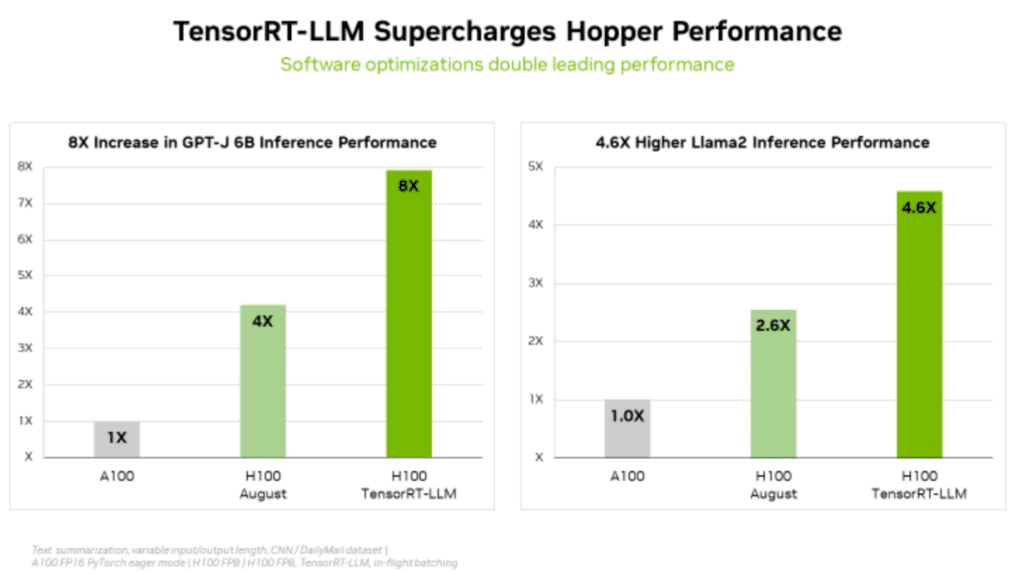

TensorRT-LLM: Çıkarım Performansını Artırma

NVIDIA sürekli inovasyonda her zaman ön saflarda yer almıştır ve TensorRT-LLM bu mirasın bir kanıtıdır. Bu üretken yapay zeka yazılımı, çıkarımı artırır ve açık kaynaklı bir kitaplık olarak gelir. Ağustos değerlendirmesi için MLPerf’e zamanında gönderilmemiş olsa da, kullanıcıların H100 GPU’larının performansını ek maliyetlere katlanmadan yükseltmelerine olanak tanıyarak umut vaat ediyor. Meta, Cohere ve Grammarly gibi ortaklar, NVIDIA’nın LLM çıkarımını geliştirme çabalarından yararlandı ve bu tür yazılım geliştirmelerinin yapay zeka alanında önemini bir kez daha doğruladı.

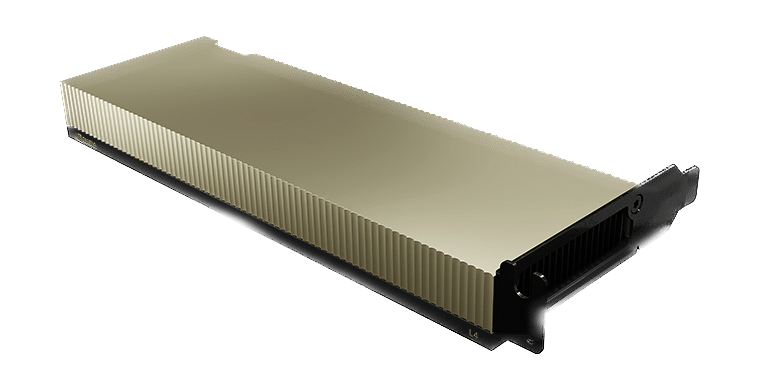

L4 GPU’lar: Ana Sunucular ile Performans Arasında Köprü Kurmak

En son MLPerf kıyaslamalarıyla L4 GPU’lar sayısız iş yükünde övgüye değer bir performans sergiledi. Bu GPU’lar, kompakt hızlandırıcılara yerleştirildiğinde, daha yüksek güç değerlerine sahip CPU’lara göre altı kata kadar daha verimli performans ölçümleri göstermiştir. CUDA yazılımıyla işbirliği içinde özel medya motorlarının piyasaya sürülmesi, L4 GPU’ya özellikle bilgisayarlı görüntü görevlerinde avantaj sağlıyor.

Sınırları Zorlamak: Uç Bilgi İşlem ve Daha Fazlası

Gelişmeler yalnızca bulut bilişimle sınırlı değil. NVIDIA’nın uç bilişime odaklanması, nesne algılamada önceki sürümleriyle karşılaştırıldığında %84’e varan performans artışı sergileyen Jetson Orin modül üzeri sistem ile açıkça görülmektedir.

MLPerf: Şeffaf Bir Karşılaştırma Standardı

NVIDIA Grace Hopper Superchip ve MLPerf, dünya genelindeki kullanıcıların satın alma kararları verirken güvendiği objektif bir kriter olmaya devam ediyor. Microsoft Azure ve Oracle Cloud Infrastructure gibi bulut hizmeti devlerinin yanı sıra Dell, Lenovo ve Supermicro gibi tanınmış sistem üreticilerinin de dahil edilmesi, MLPerf’in sektördeki öneminin altını çiziyor.

Sonuç olarak, NVIDIA’nın MLPerf kriterlerindeki son performansı yapay zeka sektöründeki liderlik konumunu güçlendiriyor. Geniş ekosistemi, sürekli yazılım yeniliği ve yüksek kaliteli performans sunma taahhüdüyle NVIDIA gerçekten de yapay zekanın geleceğini şekillendiriyor.

NVIDIA’nın başarılarına ilişkin daha derinlemesine bir teknik inceleme için bağlantılı teknik bloga bakın . NVIDIA’nın kıyaslama başarısını kopyalamak isteyenler, yazılıma MLPerf deposundan ve NVIDIA NGC yazılım merkezinden erişebilirler .